Raspberry Pi4 画像認識 ~④独自画像学習 アノテーション~

0.初めに

「Raspberry Pi4 リモートで初期設定 Raspberry Pi OS/OS Lite」、「Raspberry Pi4でTensorflow Lite 環境を構築してみる」、「Raspberry Pi 4で物体検出してみる」の3記事にわたって、Raspberry Pi4のセットアップとtensorflow・tensorflow Liteの動作環境を準備し、動作の確認を行ってきました。

ただし、使用した学習モデルは一般で気に出回っているモノを検出するモデルで、「自分が検出したいモノ」を検出できるようになっているわけではありません。

「自分が検出したいモノ」の画像、もしくは動画から検出したいモノを四角で囲う作業(アノテーション)を行ってまいりますので、画像を用意してください。

今回は、karaage0703さんのjanken_datasetを用いて検出してみます。

1.datasetをダウンロード

上記のデータセットを自分のPCにダウンロードします。

code部分からDownload ZIPでダウンロードし、解凍します。

2.Vottのインストール

アノテーション作業を行うためのアプリは様々ありますが、ここでは「Vott」というアプリを使用していきます。

まず、こちらからVottをインストールします。

github.com

3.アノテーション作業

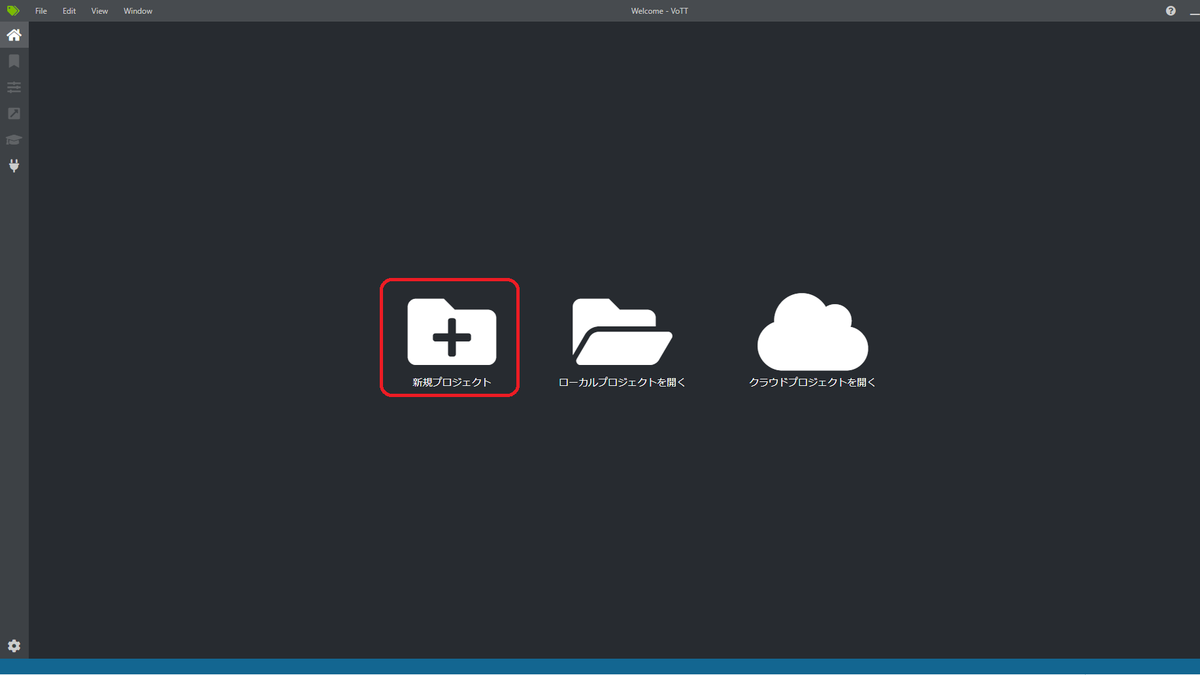

インストールが完了し、アプリを起動するとこのようになります。

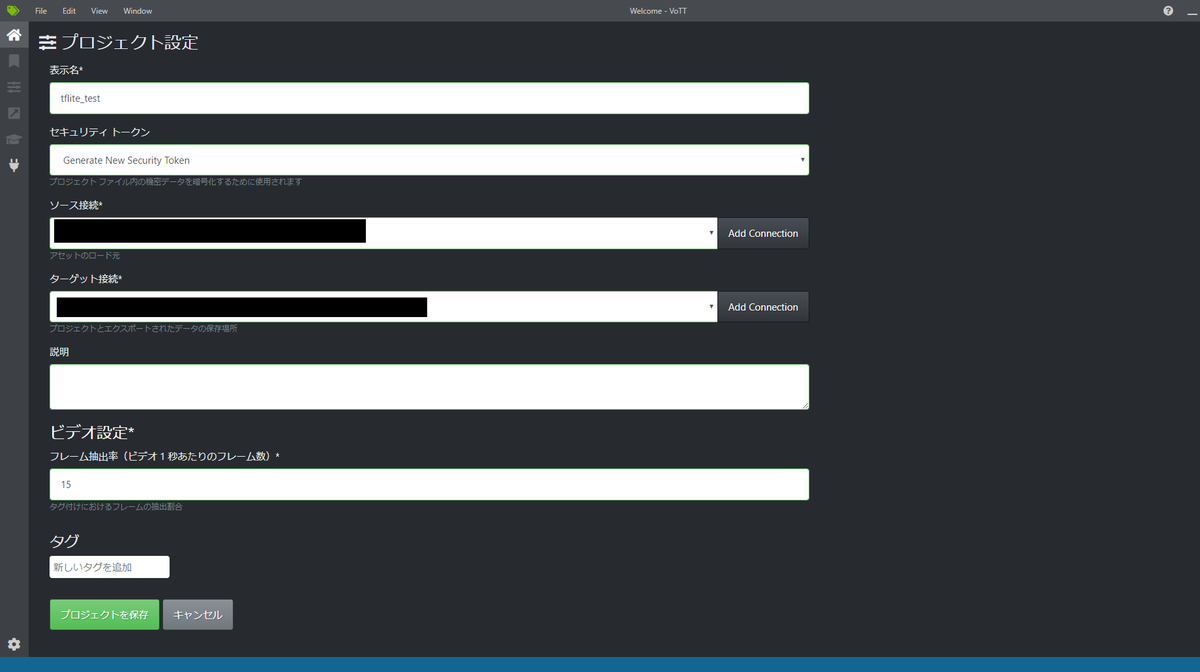

まず、新規プロジェクトを作成します。

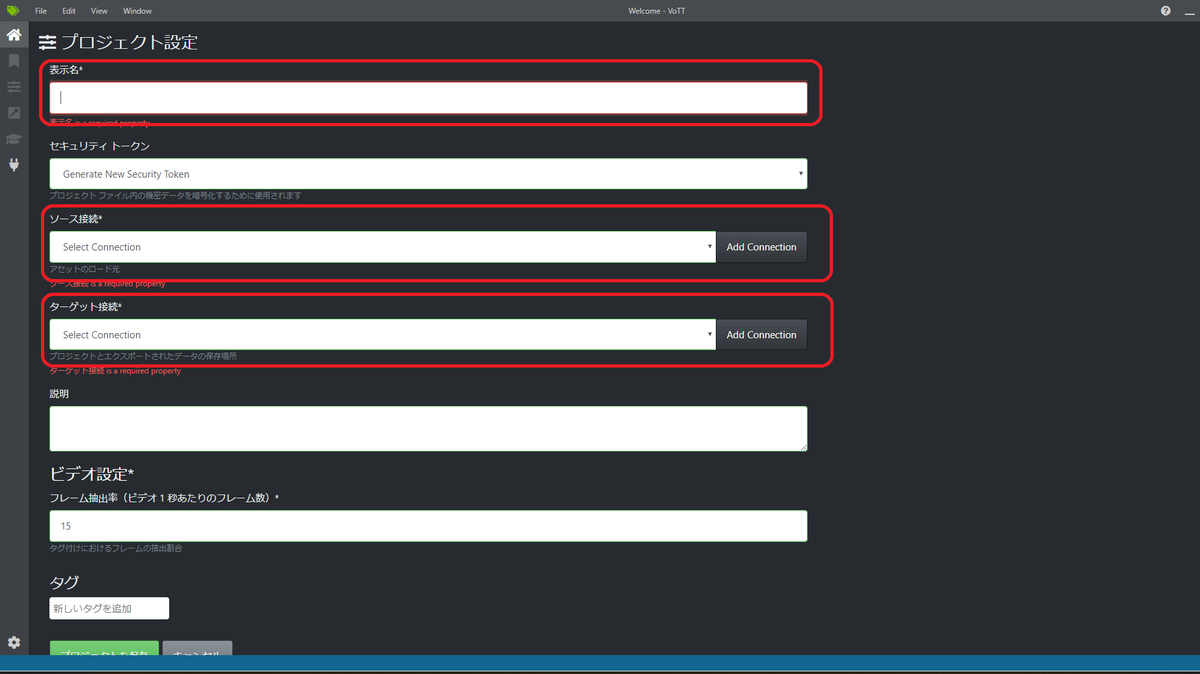

次に、表示名、ソース接続、ターゲット接続を記入していきます。

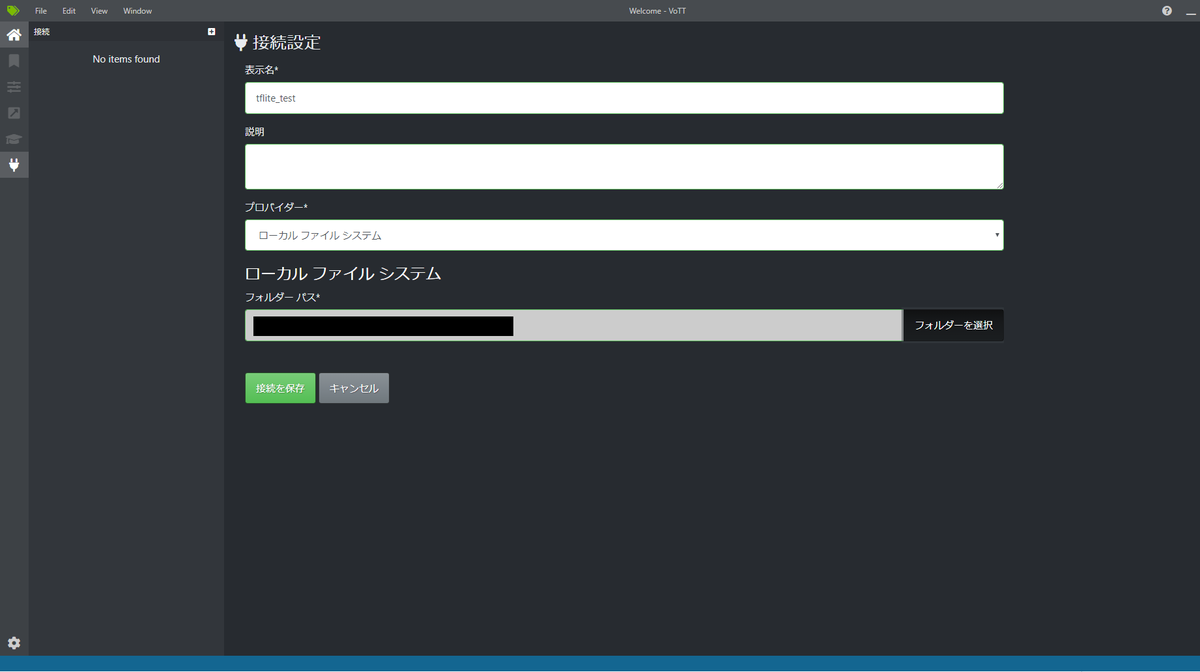

表示名はお好みでつけてください。ここではtflite_testとしました。

ソース接続、ターゲット接続の設定はそれぞれ右側にある「Add Connection」から設定します。

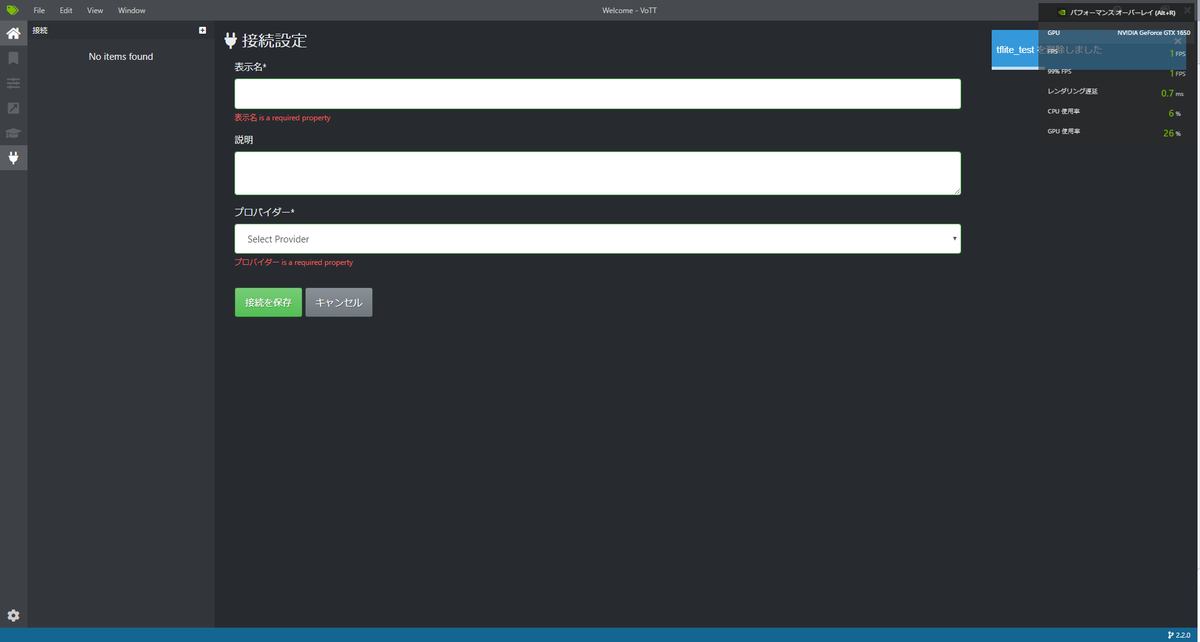

「Add Connection」を押すと次のような画面になります。

プロバイダーというところをクリックするとどこから画像を引っ張ってくるかを選択することができます。

「Azure Blob strage」や「bing 画像検索」などがありますが、今回は「ローカルファイルシステム」でPCに入っている画像を使用するので、その画像が入っているフォルダを指定します。

そして、「ソース接続」「ターゲット接続」のプルダウンから、今作成したパスを選択すれば完了なので、プロジェクトを保存をおします。

するとフォルダー内にある画像すべてが表示されます。

まず、「手」をタグ付けするために、右上「TAG」の横にあるプラスマークをおしてタグの名前を必要なだけ用意します。

その後、上部にある四角を押すことで、囲うことができます。

それぞれ、検出する「手」に対応したタグをつけることで、アノテーションができます。

4.アノテーションしたデータのエクスポート

この後行うモデルの学習で必要なデータ形式に変更する必要があります。

今回は、model makerで行うため、excelで出力するように設定をします。

また、「アセットの状態」は必ずタグ付きアセットのみにしてください。

エクスポート設定が終了したら、赤枠部分のエクスポートを実行すると出力されます。

今回は以上で終わります。

お疲れさまでした。

-

-

-

-

- 関連記事-----

-

-

-

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com

melostark.hatenablog.com